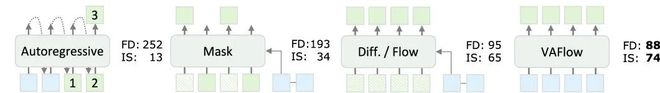

多模態生成領域,由視頻生成音頻(Video-to-Audio,V2A)的任務要求模型理解視頻語義,還要在時間維度上精準對齊聲音與動態。早期的 V2A 方法采用自回歸(Auto-Regressive)的方式將視頻特征作為前綴來逐個生成音頻 token,或者以掩碼預測(Mask-Prediction)的方式并行地預測音頻 token,逐步生成完整音頻。

這兩種方法都依賴于音頻的離散化表示,而離散化處理往往由于信息損失會限制音質上限。

最近主流方法大多采用擴散模型或流匹配架構,通過「從噪聲生成音頻」的方式來實現視頻驅動的聲音合成。這種方式不依賴離散 token 表征,直接在連續的隱空間進行建模。通過采樣隨機噪聲,并將視頻信息作為條件,模型從噪聲中逐步去噪,最終生成音頻。但是這樣的范式仍然存在兩個天然瓶頸:

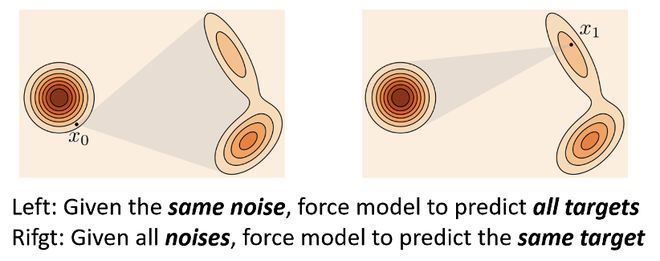

- 同一視頻條件下的多對一映射:在訓練階段,模型被訓練從不同的采樣噪聲中預測同一個音頻,多對一的映射關系增加了訓練難度;推理階段,由于不同噪聲樣本通過 ODE 求解得到的推理結果差異較大,生成的音頻質量難以保持一致,甚至出現「抽獎」現象。

- 不同視頻條件下的一對多映射:在訓練和推理階段,模型被要求從相同的采樣噪聲出發只根據不同視頻條件生成不同的音頻,這要求模型具備極強的條件處理能力。

主流擴散模型或流匹配架構的挑戰

因此,模型需要從隨機噪聲中逐步「聽懂」視頻,這一過程依賴復雜的條件機制,導致路徑復雜、訓練低效且生成結果不穩定。

在這一背景下,中國人民大學宋睿華帶領的 AIMind 團隊與值得買科技 AI 團隊提出了一個全新的框架 —— VAFlow。研究者提出:既然從噪聲到聲音依賴復雜的視頻條件機制并且有上述局限,為什么不直接從視頻出發生成聲音?

基于這一思路,團隊設計了一個直接建模「視頻→音頻」映射的跨模態流匹配框架 VAFlow。它擺脫了對高斯噪聲先驗的依賴,首次實現了從視頻分布直接生成音頻的范式轉變,并在生成質量、語義對齊與同步精度上取得了顯著突破。該研究已正式發表于 ICCV 2025。